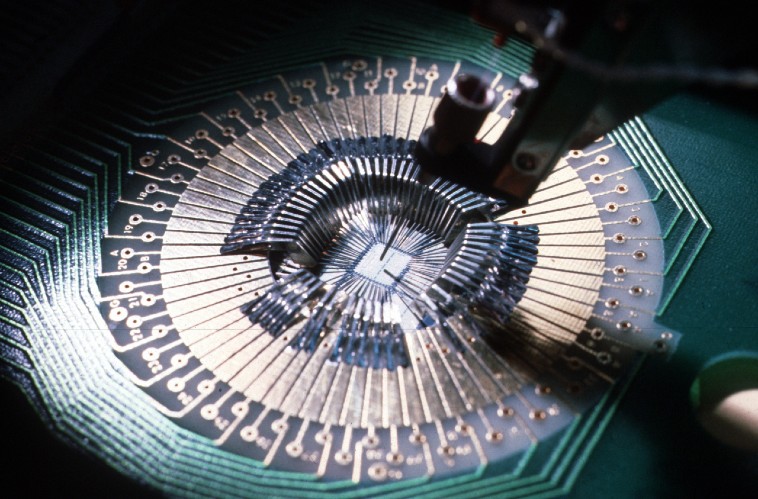

Τον καθοριστικό ρόλο της Τεχνητής Νοημοσύνης (AI) στη διαμόρφωση του σύγχρονου ψηφιακού περιβάλλοντος – τόσο ως εργαλείο άμυνας όσο και ως μέσο επίθεσης αναδεικνύει η έκθεση της Trend Micro «Trend Micro State of AI Security Report, 1H 2025».

Η μελέτη της Trend Micro καταγράφει μια εντυπωσιακή αύξηση στη χρήση Τεχνητής Νοημοσύνης από οργανωμένες κυβερνοεγκληματικές ομάδες, οι οποίες πλέον αξιοποιούν γενετικά μοντέλα AI με στόχο την ανάπτυξη ολοένα και πιο εξελιγμένων επιθέσεων. Οι δράστες στρέφονται σε τεχνικές όπως το deepfake phishing και τις στοχευμένες καμπάνιες εξαπάτησης με χρήση φυσικού λόγου (spear phishing), ενώ παράλληλα δημιουργούν κακόβουλο λογισμικό ικανό να προσαρμόζεται δυναμικά στο περιβάλλον του στόχου. Μέσω μηχανισμών μηχανικής μάθησης, αυτά τα εργαλεία καταφέρνουν να αποφεύγουν την ανίχνευση, με αποτέλεσμα να καθίστανται ιδιαίτερα αποτελεσματικά και επικίνδυνα. Η αυξανόμενη πολυπλοκότητα και ευελιξία αυτών των απειλών αποδυναμώνει αισθητά τις παραδοσιακές μεθόδους ασφαλείας.

Η ευρεία υιοθέτηση της Τεχνητής Νοημοσύνης ενισχύει σημαντικά την αποδοτικότητα των επιχειρήσεων αλλά και των επιτιθέμενων που τις στοχοποιούν. Σύμφωνα με την έκθεση, το 93% των υπεύθυνων ασφαλείας προβλέπουν ότι εντός του 2025 θα αντιμετωπίζουν επιθέσεις βασισμένες σε AI σε καθημερινή βάση. Παράλληλα, το 66% των οργανισμών που συμμετείχαν στην ετήσια έρευνα του World Economic Forum (Global Cybersecurity Outlook), θεωρούν ότι φέτος η AI θα έχει τη μεγαλύτερη επίδραση στον τομέα της κυβερνοασφάλειας.

Το αποτύπωμα της AI διευρύνεται διαρκώς, αγγίζοντας πτυχές της καθημερινότητας – από προσωπικούς βοηθούς έως αυτόνομους επιχειρησιακούς agents. Η προσθήκη ξεχωριστής κατηγορίας AI στον διαγωνισμό Pwn2Own 2025, που διεξήχθη στο πλαίσιο του OffensiveCon στο Βερολίνο, υπογραμμίζει τη σημασία της Τεχνητής Νοημοσύνης και την ανάγκη για ασφάλεια «by design» στα συστήματα που τη χρησιμοποιούν.

Την ίδια στιγμή, η ασφάλεια των ίδιων των συστημάτων AI που χρησιμοποιούν οι επιχειρήσεις εγείρει σοβαρές ανησυχίες. Πολλοί οργανισμοί ενσωματώνουν LLMs (Large Language Models) – είτε εμπορικά είτε ανοιχτού κώδικα – χωρίς να εφαρμόζουν βασικά μέτρα προστασίας. Αυτό τους καθιστά ευάλωτους σε κινδύνους όπως η ακούσια διαρροή ευαίσθητων δεδομένων, η εκμετάλλευση των prompts από κακόβουλους χρήστες, ή ακόμα και η αλλοίωση των μοντέλων μέσω τεχνικών όπως το model poisoning.

Όπως επισημαίνει ο Στιούαρτ ΜακΛέλαν, CTO του South London and Maudsley NHS Foundation Trust (SLAM), το ζήτημα της ορθής διαχείρισης των δεδομένων παραμένει κρίσιμο. Συγκεκριμένα, υπογραμμίζει: «Υπάρχουν ακόμη πολλά ερωτήματα γύρω από τα μοντέλα τεχνητής νοημοσύνης και το πώς θα μπορούσαν – και θα έπρεπε – να χρησιμοποιούνται. Στον δικό μου χώρο, υπάρχει πραγματικός κίνδυνος όταν πρόκειται για την κοινοποίηση προσωπικών δεδομένων. Συμμετέχουμε ενεργά στην εκπαίδευση και καθορίζουμε κανόνες ώστε να είναι ξεκάθαρο ποια δεδομένα βρίσκονται σε ποια τοποθεσία και τι συμβαίνει με αυτά όταν χρησιμοποιούνται από ένα μοντέλο AI».

Ωστόσο, η Τεχνητή Νοημοσύνη δεν αποτελεί μόνο μέσο επίθεσης αλλά και εργαλείο στρατηγικής άμυνας. Οι οργανισμοί που αξιοποιούν σύγχρονες πλατφόρμες κυβερνοασφάλειας βασισμένες σε AI, παρατηρούν σημαντική βελτίωση στον εντοπισμό και την απόκριση σε απειλές. Η χρήση προηγμένων εργαλείων ανάλυσης επιτρέπει την ταχύτερη αναγνώριση περιστατικών ασφαλείας και την ακριβέστερη ανίχνευση απειλών τύπου «zero-day», ενώ ενισχύει σημαντικά τη δυνατότητα πρόβλεψης κινδύνων μέσω μοντέλων συμπεριφοράς. Με τεχνολογίες όπως το XDR (Extended Detection and Response) και τις αναλύσεις σε πραγματικό χρόνο που βασίζονται σε AI, οι οργανισμοί αποκτούν τη δυνατότητα να ανιχνεύουν ύποπτη δραστηριότητα τη στιγμή που συμβαίνει, μειώνοντας δραστικά τον χρόνο εντοπισμού και αντίδρασης σε κυβερνοεπιθέσεις.

Η Trend Micro καταλήγει σε ένα ολοκληρωμένο πλαίσιο συστάσεων για ασφαλή αξιοποίηση της AI:

- Θέσπιση πολιτικής ορθής χρήσης AI – Καθορισμός εσωτερικών κανόνων και περιορισμών στη χρήση LLMs και AI APIs.

- Ασφάλεια κατά τον σχεδιασμό (Security by Design) – Επιλογή ή ανάπτυξη μοντέλων με ενσωματωμένα μέτρα προστασίας.

- Ανιχνευσιμότητα και διαφάνεια – Τεκμηρίωση της προέλευσης, των δεδομένων εκπαίδευσης και του τρόπου λειτουργίας των συστημάτων AI.

- Εκπαίδευση προσωπικού – Ενημέρωση και κατάρτιση των χρηστών και των ομάδων IT για τους σχετικούς κινδύνους.

- Ενσωμάτωση σύγχρονων εργαλείων κυβερνοάμυνας – Χρήση πλατφορμών με AI για ανίχνευση, απόκριση και προληπτική προστασία (XDR, SOAR, ML-based firewalls).

Πηγή: ot.gr